«تعالی» به جای «تقویت کارآئی» انسان ها

«هوش مصنوعی» دیگری امکان پذیر است

پیشرفت هوش مصنوعی خیرهکننده است، اما سؤالاتی را برمی انگیزد: آیا فناوری آنچه را اساسی است در نظر می گیرد؟ در دهه ۱۹۷۰، متخصصان «هیپی» رایانه، رویای ماشین هایی را در سر می پروراندند که به توسعه هوش «طبیعی» ما و ارتباط آن با جهان کمک کند.

شبحی در آمریکا در گشت و گذار است – شبح کمونیسم اما این بار دیجیتال. «آیا کمونیسمی که با هوش مصنوعی مدیریت شود ، می تواند جواب دهد ؟ این سوالی است که دارون آسم اقلو، اقتصاددان در موسسه فناوری ماساچوست (MIT) می پرسد، در همان حالی که مارک اندرسن، متخصص در سرمایه گذاری خطرپذیر از اینکه چین در حال تدارک یک هوش مصنوعی کمونیستی (IA) است، نگران می باشد (۱). حتی ویوک راماسوامی، جمهوریخواه گنده گو، بر روی شبکه X اظهار فضل کرده و خطر هوش مصنوعی کمونیستی را بیشتر از کووید-۱۹ ارزیابی می کند.

اما در میانه این هراس عمومی، چه کسی واقعاً می داند که ما در مورد چه چیزی صحبت می کنیم ؟ آیا یک هوش مصنوعی کمونیستی از مدل چینی پیروی میکند، با پلتفرمهایی که بر اساس پلتفرمهای شرکتهای بزرگ آمریکایی و تحت کنترل نزدیک دولت قرار دارند، یا بهتر بگوییم رویکرد « دولت رفاهی» به سبک اروپایی، با توسعه متمرکز در دست نهادهای دولتی را دنبال می کند ؟

این گزینه دوم جذابیت خاصی دارد، به ویژه از آنرو که مسابقه کنونی در توسعه هوش مصنوعی بیشتر بر سرعت تمایل دارد تا بر کیفیت . ما این را در ماه مه گذشته دیدیم زمانی که هوش مصنوعی گوگل(AI Overview) افزودن چسب در پیتزا و خوردن سنگ را توصیه کرده بود (۲). سرمایه گذاری عمومی بر یک هوش مصنوعی مولد، که همراه با انتخاب دقیق دادهها و همچنین نظارتی سختگیرانه باشد، میتواند کیفیت ابزارها و قیمتی که شرکتها از مشتری دریافت می کنند را افزایش دهد، در نتیجه درآمد بهتری را برای سازندگان محتوا تضمین کند.

با این حال، تلاش برای توسعه یک اقتصاد اجتماعی شده توسط هوش مصنوعی آیا به معنای تسلیم شدن در مقابل سیلیکون ولی نیست ؟ آیا یک هوش مصنوعی «کمونیست» یا «سوسیالیست» باید به تصمیم گیری در مورد مالکیت و کنترل داده ها یا اصلاح مدل ها و زیرساخت های فناوری اطلاعات محدود شود ؟ آیا نمی تواند حامل دگرگونی های عمیق تری باشد؟

دو مثال برگرفته از تاریخ معاصر پاسخ مثبتی را پیشنهاد می کند. اولین مورد CyberSyn است، ابتکار پیش گویانه رئیس جمهور شیلی، سالوادور آلنده (۳). این پروژه به رهبری یک مشاور کاریزماتیک بریتانیایی به نام استافورد بیر، به همان اندازه بلندپروازانه بودنش، عمری کوتاه داشت (۱۹۷۰-۱۹۷۳)، و هدف آن ابداع روشی کارآمدتر برای مدیریت اقتصاد با استفاده از منابع انفورماتیک کشور بود.

CyberSyn، که اغلب «اینترنت سوسیالیستی» توصیف می شود، برای ارسال تمام داده های تولیدی از شرکت های ملی به یک کامپیوتر مرکزی مستقر در سانتیاگو، بر شبکه تلکس شیلی متکی بود. با این حال، به منظور اجتناب از دام تمرکز گرائی ای شبیه شوروی، این سیستم از شکلی از یادگیری خودکار(Machine learning) پیشرس استفاده می کرد که هدف آن دادن توانائی بیشتر به کارکنان بود.

تکنسین های دولتی به کارخانه ها رفتند و همراه با کارگران کار کردند تا فرآیندهای تولید و مدیریت را همانطور که در روند روزمره اعمال می شد، طراحی کنند. این اطلاعات ارزشمند که برای مدیران در یک شرکت سرمایهداری غیرقابل دسترسی بود، سپس به مدلهای عملیاتی تبدیل و با استفاده از نرمافزار آماری خاص بررسی شد. بدین ترتیب کارگران-مدیران می توانستند تقریباً بلافاصله از هر گونه مشکلی که پیش می آمد مطلع شوند.

در قلب CyberSyn طراحی یک سیستم ترکیبی قرار داشت که می بایست با تکیه بر قدرت محاسباتی ، هوش انسان را تقویت کند. تبدیل دانش ضمنی و روزمره به دانش مدل سازی شده و ملموس برای کارگران – طبقه به تازگی قرارگرفته در راس کشور – به آنها اجازه می داد تا با اطمینان و عاقلانه با توجه به تجربه قبلی خود، در حوزه مدیریت یا اقتصاد تصمیم گیری کنند. آیا در این تجربه آنچیزی وجود ندارد که می تواند ما را در جستجوی یک هوش مصنوعی سوسیالیستی راهنمایی کند ؟

برای درک بیشتر معنای این ایده منحصر به فرد، باید به ماجراهای وارن برودی، روانپزشکی که به سایبرنتیک روی آورد، توجه نمود. او سپس یک «هیپی» شد و در حال حاضر ۱۰۰ سال سن دارد.

یک عقلانیت زیست محیطی

در پایان دهه ۱۹۶۰، آقای برودی با سرمایه یکی از همکاران ثروتمندش، یک لابراتوار آزمایشی به نام (EEL) Environmental Ecology Lab در بوستون ایجاد کرد. چند ایستگاه مترو دورتر، دوستانش ماروین مینسکی و سیمور پیپرت، در موسسه فناوری ماساچوست (MIT) – موسسه ای که برودی مدتی با آن کار کرد – در حال توسعه پروژه های هوش مصنوعی بودند که به گفته وی در مسیر اشتباهی قرار داشت. فرض مینسکی و پیپرت این بود که استدلال انسان توسط مجموعه ای از قوانین و فرآیندهای الگوریتمی انتزاعی هدایت می شود که کافی است آنها را شناسائی و سپس رمزگشایی کرد تا بتوان رایانه ای مجهز به «هوش مصنوعی» ایجاد کرد.

بر خلاف این دیدگاه، برودی و پنج همکارش معتقد بودند که هوش، به دور از حبس بودن در چارچوبه مغز ما، از تعامل با محیط مان ناشی می شود. هوش امری اکولوژیکی است. قواعد و مکانیسم های انتزاعی به خودی خود معنایی ندارند. همه چیز به محیط و شرائط بستگی دارد. آنها از یک مثال ساده برای نشان دادن این نظریه استفاده می کنند: دستور برهنه شدن، بسته به اینکه توسط پزشک، معشوق یا غریبه ای که در یک کوچه تاریک با آن مواجه شده باشید، مطلقا معنای یکسانی ندارد.

به نظر می رسد طراحی یک هوش مصنوعی که بتواند به طور مستقل این تفاوت های ظریف را درک کند، یک چالش است. علاوه بر مدلسازی فرآیندهای ذهنی انسان، باید از رایانهها خواسته شود تا بر انواع بینهایتی از مفاهیم، رفتارها و موقعیتها و همچنین همه روابط بین آنها تسلط داشته باشند – به عبارت دیگر، باید کل چارچوب فرهنگی تمدن انسانی درک شود، که تنها عنصری است که به همه چیز معنا می دهد.

تیم برودی به جای خسته کردن خود در راه هدفی دست نیافتنی ، رویای قرار دادن رایانه ها و فناوری های سایبرنتیک در خدمت انسان ها را در سر می پروراند تا به آنها اجازه اکتشاف و همچنین غنی سازی محیط و به ویژه شخص خود را بدهد. از این منظر، فناوری اطلاعات نه تنها ابزاری برای انجام کارها و تکالیف، بلکه وسیله ای برای اندیشیدن به جهان و تعامل با آن است. به عنوان مثال، یک دوش سایبرنتیک را تصور کنید که در چارچوب تغییرات آب و هوا و کمبود منابع آب به شما هشدار و انتخاب دهد، یا ماشینی که برای یک سفر به شما با تکیه بر سود زیست محیطی، استفاده از سیستم حمل و نقل عمومی را توصیه کند. در این لابراتوار حتی لباسی اختراع شد که وقتی آن را برای رقص می پوشید، موسیقی را سریعا تغییر می دهد و پیوندهای پیچیده بین صداها و حرکات بدن را آشکار می کند.

آزمایشگاه اکولوژی محیطی(EEL) بصورتی قاطعانه دیدگاه مخالف مکتب فرانکفورت و انتقاد آن از عقل ابزاری را اتخاذ کرد: این سرمایهداری صنعتی و نه فناوری است، که جهان ما را از بعد زیست محیطی آن محروم و ما را مجبور میکند به سمت عقلانیت ابزاری که توسط تئودور آدورنو، ماکس هورکهایمر و هربرت مارکوزه تقبیح شده است، روی آوریم. برای بازگرداندن این بُعد گمشده، این آزمایشگاه قصد داشت ما را با کمک حسگرها و رایانه ها از پیچیدگی های نهفته در پشت جنبه های هستی از جمله پیش پا افتاده ترین ها آنها، آگاه کند.

ایدههای خیالانگیز برودی اثری عمیق، اما بهطور متناقضی تقریباً نامرئی، بر فرهنگ دیجیتال ما بر جای گذاشته است. برودی در طول کار کوتاه مدت خود در MIT، نیکلاس نگروپونته، یک تکنسین آرمانگرای(تکنواتوپیست) آوانگارد را تحت حمایت خود گرفت که کار وی در آزمایشگاه رسانه MIT تا حد زیادی به تعریف اصطلاحات بحث های پیرامون انقلاب دیجیتالی کمک کرد (۴). با این حال، نگاه فلسفی این دو مرد کاملاً متفاوت بود.

برودی معتقد بود که دستگاه های سایبرنتیک نسل جدید باید در درجه اول با «حساسیت» خود وسیله ای برای تسهیل گفتگوی انسان و ماشین و تشدید آگاهی اکولوژیکی ما باشد. فرض او این بود که افراد صادقانه در آرزوی تکامل خویش هستند و رایانه را متحدی در این روند تحول دائمی می دید. شاگرد او، نگروپونته، این مفهوم را بازخوانی کرد تا آن را قابل انعطاف پذیرتر کند: وظیفه اصلی ماشین ها درک، پیش بینی و ارضای نیازهای فوری ما است. به طور خلاصه، نگروپونته به دنبال ایجاد ماشینهای بدیع و غیرعادی بود، در حالی که برودی، که متقاعد شده بود هوشمندی – و به طور خلاصه هوش – بدون انسان نمیتواند وجود داشته باشند، به دنبال خلق انسانهای اصیل و بدیع بود. سیلیکون ولی دیدگاه نگروپونته را پذیرفت.

عنصر دیگری برودی را از همتایانش متمایز می کرد: در حالی که دانشمندان رایانه آن زمان هوش مصنوعی را ابزاری برای «تقویت کارآئی» انسان می دانستند – ماشین هایی که کارهای ساده را برای افزایش بهره وری انجام می دهند – او «تعالی» انسان را هدف قرار داد – مفهومی که بسیار فراتر از کارایی صرف بود (۵).

تمایز بین این دو پارادایم ظریف، اما حیاتی است. این «تقویت کارآئی» زمانی است که مثلا شما از GPS تلفن همراه برای یافتن مسیر خود در محیط های ناآشنا استفاده می کنید: این به شما امکان می دهد سریعتر و راحت تر به مقصد برسید. سود رسانی آن با این حال، زودگذر باقی می ماند. اگر این عصای تکنولوژیک را از شما بگیرند، خود را حتی بیشتر از قبل مستاصل خواهید یافت. «تعالی» اما استفاده از فناوری برای توسعه مهارتهای جدید است – در اینجا «تعالی» معادل تقویت حس جهتگیری ذاتی فرد با استفاده از تکنیکهای پیشرفته برای به خاطر سپردن یا یادگیری رمزگشایی نشانههای طبیعت است.

در واقع، «تقویت کارآئی» بنام اثربخشی، توانائی های ما را از بین می برد ، در حالی که «تعالی» به ما قابلیتهای جدیدی میدهد و تعاملات ما را با جهان غنی تر میکند. از این تفاوت اساسی است که روشی نشأت میگیرد که ما براساس آن فناوری را در زندگی خود وارد میکنیم تا خود را به عملگری منفعل یا کنشگری خلاق تبدیل کنیم.

برودی به این باورها در حین شرکت به عنوان روانپزشک در یک برنامه کمابیش مخفی آژانس اطلاعات مرکزی (سیا) در اوایل دهه ۱۹۶۰ رسیده بود. سازمان سیا قصد داشت با آموزش زبان روسی به افراد نابینا، از آنها برای گوش دادن به ارتباطات رهگیری شده شوروی استفاده کند. فرض براین بود که به دلیل نابینایی، حواس دیگر آنها قوی تر از افراد دیگر است. برودی پس از چندین سال کار با این افراد برای شناسایی نشانههای داخلی و خارجی – گرمای بدن، رطوبت محیط، کیفیت نور و غیره – که برای تقویت ادراکات خود استفاده میکردند، متوجه شد که توانایی آنها در تقویت حواس در واقع مشترک است.

اگر این فکر که برنامه «تعالی» می تواند به همه ما حساسیت هنری قوی بدهد، شاعرانه بود، برودی، با عملگرائی اصلاحناپذیرش، اجرای آن را بدون کمک رایانه غیرممکن میدانست. هنگامی که او سعی کرد آن را به عنوان یک حوزه تحقیقاتی رسمی وارد MIT کند، با مخالفت شدیدی و نه فقط از جانب نخبگان محافظه کار هوش مصنوعی روبرو شد. دیگران نیز در آن مفاهیم تاریک نازی را می دیدند: مگر نه اینکه برودی آزمایشهایی را روی انسانها پیشنهاد میکرد ؟ این مخالفت ها در نهایت او را مجبور کرد که به اهداکنندگان خصوصی روی آورد.

تفاوت عمیق بین «تقویت کارآئی» و «تعالی» انسان – و پیامدهای آن برای اتوماسیون – تنها چند دهه بعد آشکار شد. هدف «تقویت کارآئی» ، ایجاد ماشین هایی است که مانند ما فکر و احساس می کنند و با خطر منسوخ کردن مهارت های ما همراه است. ابزارهای فعلی مبتنی بر هوش مصنوعی مولد ، هدفشان فقط افزایش کار هنرمندان و نویسندگان نیست، بلکه جایگزینی کامل آنهاست. برعکس، فنآوریهای هوشمند برودی قصد نداشت توانائی های بشری را منسوخ و یا موجودیت انسانها را استاندارد سازی کند، وعده آنها غنی کردن ذائقه و گسترش تواناییهای ما بود، به عبارت دیگر به جای نابود کردن تجربه انسان، تقویت نمودن آن.

ظرفیت های خفته انسانی را آزاد کنید

این دیدگاهی شجاعانه در آنزمان زمان بود . اکثریت نمایندگان پادفرهنگ، فناوری را نیرویی ناشناس و بی روح می دانستند که باید نسبت به آن غیر قابل اعتماد بود و در جوامعی که از «بازگشت به زمین» حمایت می کردند، فقط می شد از آن به عنوان ابزاری برای رهایی منحصرا فردی استفاده کرد. وقتی برودی این ایده ها را در اواسط دهه ۱۹۶۰ مطرح کرد، زندگی حرفه ای و خانوادگی خود را از هم پاشید. در حالیکه مواضع او ، وی را به سمت آوانگاردترین هسته قدرتمدار آمریکا سوق می داد، او مانند بسیاری از اعضای جنبش هیپی، مشروعیت سیاست را به رسمیت نمی شناخت و همین امر او را از تبدیل نظریه هایش به مطالبات عینی باز می داشت.

در آن سوی کره زمین، فیلسوفی در شوروی به نام اوالد ایلینکوف، که مانند او در سال ۱۹۲۴ به دنیا آمده بود، از خود سؤالاتی بسیار مشابه، اما در چارچوب «مارکسیسم خلاق» می کرد. کار او اجازه می دهد که درک بهتری از مفهوم «تعالی» انسانی در چارچوب اندیشه کمونیستی و سوسیالیستی داشت.

ایلینکوف نیز مانند برودی، به طور گسترده با افراد نابینا کار کرده بود. او از مطالعات خود به این نتیجه رسید که توانایی های شناختی و حسی از اجتماعی شدن و تعامل با فناوری ناشی می شود. با ایجاد محیط های آموزشی و فناوری مناسب ، می توانیم مهارت هائی که در حالت نهفته در وجودمان هست را پرورش دهیم. بنابراین هدف کمونیسم، تحت رهبری دولت، رهاسازی ظرفیتهای خفته انسانی است تا همه بتوانند بدون توجه به موانع اجتماعی یا طبیعی، ظرفیت های بالقوه خود را بهطور کامل شناسایی کنند.

ایلینکوف که از شیفتگی بوروکراتهای شوروی نسبت به هوش مصنوعی سبک آمریکایی خشمگین شده بود، در مقالهای در سال ۱۹۶۸ با عنوان «بتها و ایدهآلها» (۶) انتقاد قانعکنندهای از آن ارائه کرد. از نظر او، توسعه هوش مصنوعی شبیه به ساختن یک کارخانه عظیم تولید شن و ماسه مصنوعی در قلب صحرا بود. حتی با این فرض که این کارخانه عملکرد کاملی داشته باشد، استفاده نکردن از منابع طبیعی ای که به وفور در آنسوی دیوارهای آن وجود داشت، بی معنی بود.

تقریباً شصت سال بعد، محکومیت هوش مصنوعی توسط ایلینکوف اهمیت هیچ یک از استدلال های خود را از دست نداده است. ما هنوز حبس در صحرا ، از درستی ایجاد کارخانه دفاع می کنیم، بی آنکه توانائی دیدن آنرا داشته باشیم که هیچ کس، جز کارکنان و معماران نظم اقتصادی، واقعاً به آن نیاز ندارد. برودی همچنین از تصویر دیگری استفاده کرد که از مارشال مک لوهان به عاریت گرفته شده بود: فناوری های زیست محیطی او این قدرت را داشتند که ما را هوشیار کنند، مانند ماهی که ناگهان از وجود آب آگاه می شود. به همین ترتیب، وقت آن رسیده است که کسی به مدافعان کور هوش مصنوعی نشان دهد که توسط مخزن عظیمی از هوش انسانی و خلاقیت غیرقابل پیشبینی و شاعرانه احاطه شدهاند.

یک سوال بزرگ باقی میماند: آیا اگر همچنان از مفاهیمی مانند هوش مصنوعی که به نظر میرسد با ایده توسعه انسانی در تضاد است، استفاده کنیم، واقعاً میتوانیم پیشرفت کنیم ؟

جاه طلبی برای ساخت هوش مصنوعی نه تنها میلیاردها دلار را بلعیده بلکه برای برخی، هزینه شخصی نیز داشته است. افراط گرگ های جوانی که بر گسترش به اصطلاح «هوش مصنوعی» نظارت داشتند – با گردآوری سرمایه های نجومی و تعریف سفت و سخت از مرزهای آن – منجر به منزوی کردن متفکران پیشگوئی مانند استافورد بیر و وارن برودی شد که همیشه استفاده از برچسب «هوش مصنوعی» برایشان ناراحت کننده بود.

این دو مرد که مدت کوتاهی قبل از مرگ نفر اول در سال ۲۰۰۲ فرصت ملاقات با یکدیگر را یافتند، پیشینه های کاملاً متضادی داشتند. بیر یک مدیر بازرگانی سابق، یکی از اعضای باشگاه نخبگان « آتنائوم » بریتانیا بود. برودی در تورنتو در یک خانواده یهودی طبقه متوسط بزرگ شده بود. این امر مانع از آن نشد که آنها احساس تحقیری مشترک نسبت به هوش مصنوعی به عنوان یک رشته علمی و دگماتیسم طرفدارانش داشته باشند. آنها همچنین یک پدر معنوی مشترک داشتند: وارن مک کالوچ، غول سایبرنتیک.

سایبرنتیک درست پس از جنگ جهانی دوم زیر نظر ریاضیدان نوربرت وینر متولد شد. بسیاری از محققین که در زمینه های مربوطه (ریاضیات، فیزیولوژی عصبی، مهندسی، زیست شناسی، انسان شناسی و غیره) پیشگام بودند، متوجه یک مشکل مشترک شده بودند: همه آنها با فرآیندهای پیچیده و غیرخطی مواجه شده بودند که در آن تشخیص علل و معلولی تأثیرات یک فرآیند طبیعی یا اجتماعی معین بصورتی همزمان با فرآیند دیگری ممکن نبود.

سایبرنتیک که حول این ایده علیت متقابل و همپوشانی پدیدههای به ظاهر مستقل شکل گرفت، قبل از اینکه یک رشته علمی باشد یک فلسفه بود. متفکران بزرگ آن حوزه پژوهشی اولیه خود را رها نکردند، بلکه تحلیل های خود را با دیدگاهی جدید غنی نمودند. رویکرد میان رشتهای، درک فرآیندهای کار در ماشینها، مغز انسان و جوامع را با استفاده از یک مجموعه مفاهیم ممکن میساخت.

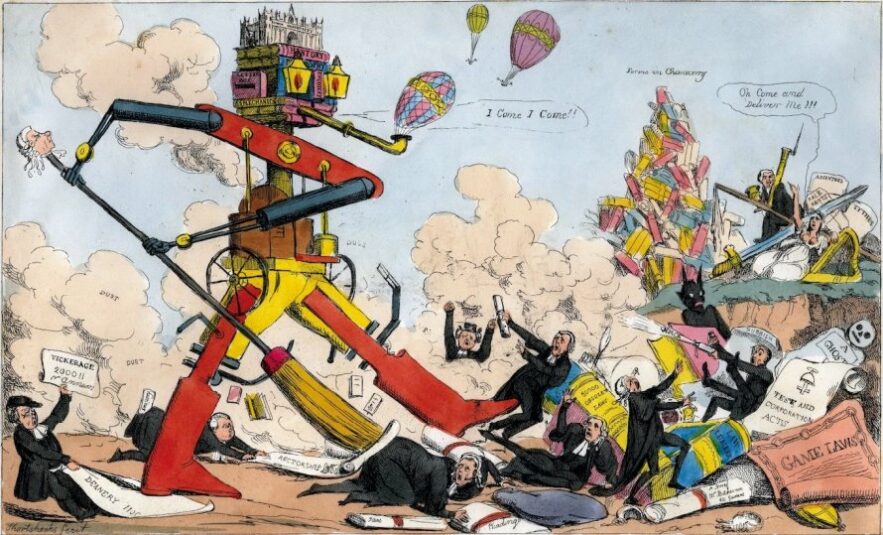

هنگامی که هوش مصنوعی در اواسط دهه ۱۹۵۰ ظاهر گردید، به عنوان یک شاخه طبیعی از سایبرنتیک دیده شد. اما در واقع یک پسرفت نسبت به آن بود. سایبرنتیک میخواست از ماشینها الهام بگیرد تا درک بهتری از هوش انسان بدست آورد و نه بازتولید آن. رشته نوظهور هوش مصنوعی بی هیچ واهمه ای ، شروع به گشودن مسیر جدیدی با تولید ماشینهایی کرد که قادر به «فکر کردن» مانند ما بودند. هدف نه کشف اسرار مکانیسم تفکر انسان ، بلکه برآوردن نیازهای مشتری اصلی آن یعنی ارتش بود. این رشته بلافاصله در دام الزامات دفاعی افتاد که برای توسعه آینده آن تعیین کننده بود.

بدین ترتیب، برخی از پروژه های اولیه با الهام از فلسفه سایبرنتیک، مانند تلاش برای ساخت شبکه های عصبی مصنوعی، به سرعت به سمت اهداف نظامی هدایت شدند. ناگهان هدف این شبکهها حل کردن پیچیدگیهای فکری نبود، بلکه به تجزیه و تحلیل تصاویر هوایی برای یافتن کشتیها یا نفتکشهای دشمن پرداختند. بنابراین، تلاش بلندپروازانه برای هوش مصنوعی به قراردادهای پیش پا افتاده نظامی با پوششی از اعتبار علمی ختم شد.

در این بستر، روش های بین رشته ای چندان طرفدار نداشت. هوش مصنوعی تحت تسلط ریاضیدانان جوان و باهوش یا مهندسین رایانه ای بود که سایبرنتیک را بسیار انتزاعی، فلسفی و مهمتر از همه بالقوه ویرانگرانه میدانستند. باید گفت که در این بین نوربرت وینر شروع به حمایت از مبارزات اتحادیه ها و انتقاد از ارتش کرده بود، امری که احتمال جذب بودجه از پنتاگون را از بین برده بود.

هوش مصنوعی که وعده «افزایش» توانائی عوامل انسانی و توسعه سلاح های خودران را می داد، مشکل داشتن تصویری بد همچون وینر را نداشت چرا که از ابتدا خود را همچون یک رشته علمی جداگانه معرفی کرده بود. در حالی که علوم سنتی به دنبال شناخت جهان هستند، گاهی با کمک الگوسازی، پیشگامان هوش مصنوعی تصمیم گرفتند تا مدلهای سادهسازی شدهای از یک پدیده دنیای واقعی – یعنی هوش – بسازند و سپس ما را متقاعد کنند که هیچ چیز اولی را از دومی متمایز نمیکند. کمی مانند آنکه جغرافی دانانی مرتد رشته جدیدی به نام «سرزمین مصنوعی» ایجاد و سعی کنند مردم را به این باور برسانند که با پیشرفت فناوری، نقشه و سرزمین به زودی به یک چیز تبدیل خواهند شد.

از بسیاری جهات، مسیر – و تراژدی – هوش مصنوعی در طول جنگ سرد شبیه علم اقتصاد، به ویژه در آمریکا است. اقتصاد در ایالات متحده موضوع تفکری جنجالی و متکثر، هماهنگ با پویایی های دنیای واقعی بود، که بر اساس آن گویا قدرت و نهادها (از اتحادیه ها گرفته تا فدرال رزرو) بر تولید یا رشد واقعی تأثیری تعیین کننده دارند. اولویتهای جنگ سرد اقتصاد را به رشتهای غرق در وسواس مدلهای انتزاعی – بهینهسازی، تعادل، نظریه بازی و غیره – مبدل کرد که ارتباط آنها با زندگی واقعی اهمیت ثانوی داشت. حتی اگر برخی از برنامههای دیجیتالی خاص، مانند تبلیغات آنلاین یا خدمات خودرو به همراه راننده (VTC) امروز بر این ساختارهای ریاضی تکیه دارند، درست بودن مقطعی چنین روش یک سویه ای به تنهائی برای اثبات صحت کل گرایش صرفا دیجیتالی کافی نیست. واقعیت این است که اقتصاد ارتدکس مدرن برای مشکلاتی مانند نابرابری یا تغییرات اقلیمی به جز راه حل های مبتنی بر بازار چیز زیادی برای ارائه ندارد.

این تحلیل در مورد هوش مصنوعی نیز صدق میکند، که اگرچه به عنوان یک پیروزی فناوری توصیف میشود، اما اغلب پوششی برای نظامیگری یا سرمایهداری است. منادیان آن ممکن است نیاز به ایجاد حداقل کنترل و مقررات را تشخیص داده باشند، اما قادر نیستند آینده ای را تصور کنند که در آن تصور ما از «هوش انسانی» تحت سلطه «هوش مصنوعی» نباشد. در آغاز «هوش مصنوعی» کمتر یک علم بود تا ترکیبی از دین و مهندسی. چرا که مشخصه علم نداشتن اهداف نهایی از پیش تعیین شده است . هدف نهایی آن ایجاد یک سیستم رایانه ای جهانی بود که قادر به انجام هر نوع کاری بدون نیاز به آموزش صریح برای انجام آن باشد – چیزی که تحت عنوان هوش جامع مصنوعی (AGI) شناخته می شود.

در اینجا امر مشابه دیگری با اقتصاد دیده می شود: در طول جنگ سرد، AGI به گونه ای دیده می شد که اقتصاددانان به بازار آزاد می نگرند، یعنی به عنوان یک نیروی خودمختار و خود تنظیم کننده، که بشریت مجبور است با آن سازگار شود. از یک سو، اندیشه اقتصادی نقشی را که خشونت استعماری، مردسالاری و نژادپرستی در گسترش سرمایه داری ایفا کرده، نادیده می گیرد و گویی گرایش انسان به «تردد [و] مبادله یک کالا با کالای دیگر» بر طبق فرمول معروف آدام اسمیت، بصورتی طبیعی ادامه یافته است(۷). از سوی دیگر، روایت سنتی از منشأ هوش مصنوعی اگر چه سهم سایبرنتیک، ریاضیات و منطق را به رسمیت می شناسد، اما در مورد زمینه تاریخی یا ژئوپلیتیکی آن سکوت می کند. مانند اینکه ما به سادگی اصلاح نژاد و جمجمه شناسی را به عنوان شاخههای ژنتیک و زیستشناسی بازشناسیم، بدون اینکه چیزی در مورد بُعد نژادپرستانه آنها بگوییم. فراموش نکنیم، یاردن کاتز در اثر قابل توجه خود ، «سفید بودن مصنوعی(۷)» (Artificial Whiteness(7)) تاکید می کند که هوش مصنوعی بدون نظامی گری، ابرشرکت محوری و میهن پرستی تشدید شده جنگ سرد هرگز وجود نداشت.

آیا می توان روزی چنین مفهوم انحرافی را در خدمت جاه طلبی های مترقی قرار داد ؟ آیا فراخوانی برای «هوش مصنوعی کمونیستی» به همان اندازه رویای کارگاه های کاراجباری با چهره انسانی یا ابزارهای شکنجه خوشایند بیهوده نیست ؟

آزمایشهای استافورد بیر و وارن برودی نشان میدهد که بهتر است خیالپردازی هوش مصنوعی سوسیالیستی را کنار بگذاریم و بر تعریف سیاست فناوری سوسیالیستی پسا هوش مصنوعی تمرکز کنیم. به جای تلاش برای انسانی کردن محصولات موجود با تصور برنامه های کاربردی چپ برای آنها یا با ابداع مدل های جدید مالکیت اقتصادی، ما باید دسترسی همه بدون توجه به طبقه، قومیت یا جنسیت به موسسات، زیرساخت ها و فناوری هایی که خلاقیت مستقل را ارتقا می دهند، ممکن سازیم تا مردم به طور کامل از توانایی هایشان بهره برند. به عبارت دیگر، ما باید گذار از انسان هائی با « کارآئی تقویت » شده به انسان های «متعالی» را آغاز کنیم.

زندگی کردن در یک بالن ، نه یک حباب

چنین سیاستی بر آن دسته از مؤلفههای دولت رفاه تکیه میکند که از تحمیلات محافظهکار سرمایهداری دورتر هستند: آموزش و فرهنگ، کتابخانهها، دانشگاهها و انتشار دهندگان عمومی. امری که به جای تقویت اقتصاد نئولیبرالی مانند رویکرد مسلط کنونی، راه را برای یک سیاست آموزشی و فرهنگی سوسیالیستی باز کند،.

خود برودی سریعاً فهمیدکه بدون سوسیالیسم، هوش مصنوعی سوسیالیستی وجود نخواهد داشت. از آغاز دهه ۱۹۷۰، او متوجه شد که زمینه جنگ سرد در ایالات متحده، تلاش او برای «تعالی انسانی» و «تکنولوژی زیست محیطی» را بی معنی کرده است . البته ناگفته نماند که او با امتناع از دریافت پول از سوی پنتاگون و حتی از نهادهایی مانند MIT، مخالفت خود را با جنگ ویتنام نشان می داد.

به گفته نگروپونته، برودی هرگز نمی خواست کارمند رسمی MIT شود. دست یابی به آسایش شخصی هدف او نبود و ترجیح داد برای خود خانه ای از فوم و بالن در وسط جنگل، در نیوهمپشایر بسازد. یک محیط « واکنشگرا و هوشمند» که او برای خود مناسب می دانست. اما این امر حتی برای طرفداران او نیز زیاده روی بود. نگروپونته در آن زمان با کنایه گفته بود: «همه نمی خواهند در یک بالن زندگی کنند».

تفکر برودی آغشته به آرمان شهری بود. او و نزدیکترین همکارش، اوری جانسون، امیدوار بودند که صنعت آمریکا چشمانداز آنها را بپذیرد – محصولاتی واکنشگرا و تعاملی که به جای تشدید تمایلات مصرف گرایانه، سلیقهها و علایق جدیدی را در کاربران ایجاد کند. اما شرکتها نسخه محافظهکارانهتر نگروپونته را انتخاب کردند، که در آن تعامل بیش از همه به ماشینها اجازه میدهد تا نگرانیهای ما را شناسایی کنند و ما را وادار به خرید بیشتر نمایند.

در سال ۱۹۷۳، برودی سرخورده به نروژ نقل مکان کرد. او در آنجا مائوئیست شد، یکی از اعضای فعال حزب کارگران کمونیست، و حتی به چین رفت تا در مورد مفهوم «فناوری های واکنشگرا » خود با مهندسان صحبت کند. برای مردی که از نزدیک با ارتش، اداره ملی هوانوردی و فضایی (ناسا) و پروژههای سیا در طول جنگ سرد درگیر بود، این یک تغییر جبهه بی اهمیت نبود.

با توجه به گفتگوهای طولانی من با او در ده سال گذشته در نروژ، جایی که او هنوز در آنجا زندگی می کند، برودی هنوز از پروژه «تکامل باز» خود که در دهه ۱۹۶۰ مطرح کرد، دفاع می کند. این بدان معنی است که شاید این پروژه برای همه ما کارساز باشد – به شرطی که فناوری های مناسب را انتخاب کنیم و مقداری کافی از شک و تردید نسبت به هوش مصنوعی را در خود پرورش دهیم ، حال می خواهد این هوش مصنوعی کمونیستی باشد یا غیر کمونیستی.

۱- Daron Acemoğlu, « Would AI-enabled communism work ? », ۲۸ juin 2023, www.project-syndicate.org. Cf. aussi « Marc Andreessen : Future of the Internet, technology, and AI », podcast de Lex Fridman, no 386, 21 juin 2023. ۲- Stephen Morris et Madhumita Murgia, « Google’s AI search tool tells users to “eat rocks” for your health », Financial Times, Londres, 24 mai 2024.

۳- مقاله « آلنده، انفورماتیک و انقلاب» لوموند دیپلماتیک ، ژوئیه ۲۰۱۰https://ir.mondediplo.com/2010/07/article1581.html و Cf. le podcast « The Santiago Boys », ۲۰۰۳

۴- En particulier par son livre Being Digital, traduit en français sous le titre L’Homme numérique, Robert Laffont, Paris, 1995.

۵- La première publication de Brodey adoptant cette approche date de 1967, bien qu’il s’employât à la promouvoir depuis 1964 : Warren Brodey et Nilo Lindgren, « Human enhancement through evolutionary technology », IEEE Spectrum, vol. 4, n° ۹, New York, septembre 1967.

۶- Non traduit. On en trouvera un résumé dans Keti Chukhrov, « The philosophical disability of reason : Evad Ilvenkov’s critique of machinic intelligence », Radical Philosophy, no 207, Londres, printemps 2020.

۷- Adam Smith, Recherches sur la nature et les causes de la richesse des nations, livre I.

۸- Yarden Katz, Artificial Whiteness : Politics and Ideology in Artificial Intelligence, Columbia Univer- sity Press, New York, 2020.

Evgeny Morozov